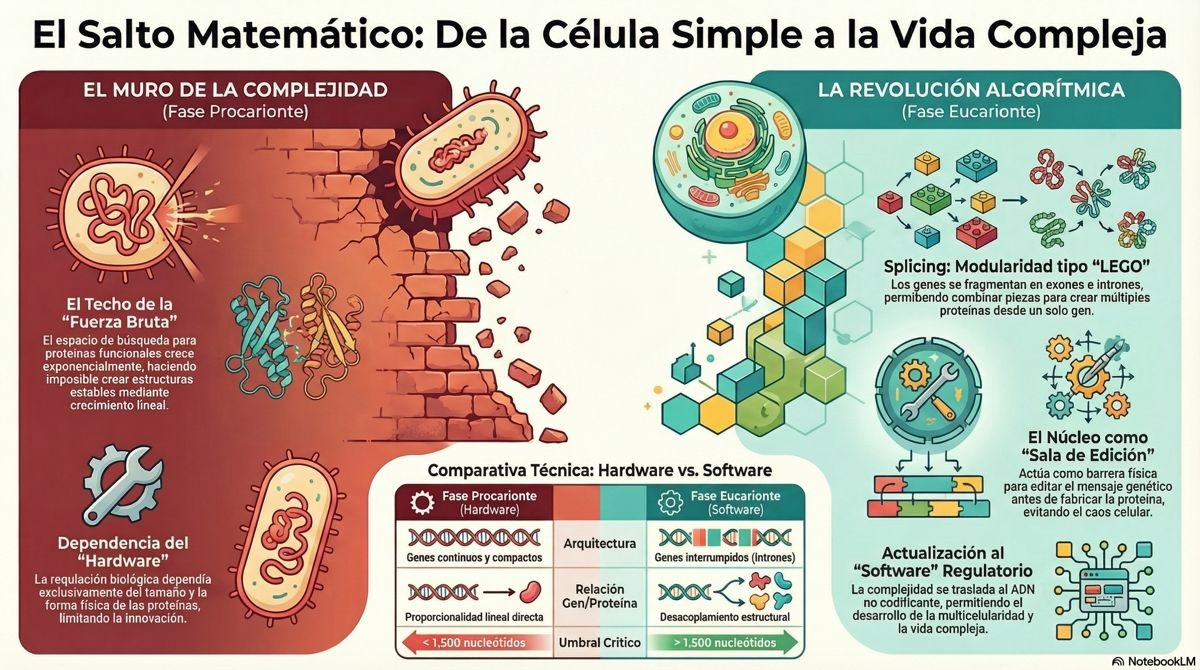

Científicos españoles proponen un cambio de paradigma radical: el surgimiento de la célula compleja no fue un accidente fortuito, sino una respuesta matemática obligada ante los límites físicos de la computación proteica.

Este hallazgo, galardonado con el Premio Cozzarelli 2025, revela que la evolución abandonó la «fuerza bruta» del hardware biológico para adoptar un software regulatorio basado en el splicing y el ADN no codificante, permitiendo así el desarrollo de la multicelularidad y la vida tal como la conocemos.

El muro computacional: Por qué la vida simple se estancó

La historia de la vida en la Tierra se ha interpretado tradicionalmente como una sucesión de adaptaciones azarosas y acumulativas, un proceso de ensayo y error donde la selección natural esculpe formas biológicas a partir de mutaciones fortuitas.

Sin embargo, una investigación pionera liderada por científicos españoles y publicada en la revista Proceedings of the National Academy of Sciences (PNAS) propone un cambio de paradigma radical: el surgimiento de la célula compleja o eucariota no fue un accidente, sino una respuesta obligada ante un límite físico y computacional insuperable para las células simples.

Este fenómeno, descrito como una transición de fase algorítmica, sugiere que la evolución cambió su «sistema operativo» hace aproximadamente 2600 millones de años para superar un cuello de botella que amenazaba con estancar la complejidad biológica para siempre.

La relevancia de este hallazgo, que ha sido galardonado con el prestigioso Premio Cozzarelli de la Academia Nacional de Ciencias de Estados Unidos en 2025, radica en su capacidad para ofrecer una explicación cuantitativa y matemática a lo que los biólogos evolutivos han denominado el «agujero negro» en el corazón de la biología.

Hasta ahora, la teoría endosimbiótica —la fusión de una arquea y una bacteria para formar la mitocondria— explicaba el origen energético de los eucariotas, pero no existía un marco que explicara cómo se reorganizó la arquitectura genética para permitir el desarrollo de organismos multicelulares, la sexualidad y la sociabilidad.

El marco teórico: La complejidad como problema de computación

Para comprender la raíz de este descubrimiento, es necesario analizar la tensión fundamental que enfrentaron los organismos procariontes (bacterias y arqueas) durante los primeros mil quinientos millones de años de vida en el planeta. En estos organismos, la regulación genética depende casi exclusivamente de las proteínas. Estas moléculas actúan como los «operarios» de la célula, encargándose de activar o desactivar genes en respuesta a estímulos externos e internos.

A medida que la vida intentaba volverse más compleja, la estrategia evolutiva consistió en alargar las proteínas para que pudieran hacer funciones más sofisticadas. No obstante, esta vía de crecimiento lineal chocó contra un muro invisible. En términos de computación, el espacio de búsqueda para encontrar una proteína funcional crece exponencialmente con su longitud. Para una cadena de aminoácidos suficientemente larga, las posibilidades de configuración son tan vastas que resulta estadísticamente imposible encontrar una estructura estable y útil mediante procesos de crecimiento simple.

Este «techo» computacional impedía que las bacterias y arqueas desarrollaran niveles superiores de organización. La evolución se encontraba atrapada en una fase donde la única forma de ganar complejidad era ineficiente y peligrosa para la estabilidad del sistema.

El equipo de investigación, integrado por Enrique M. Muro (Universidad de Maguncia), Fernando J. Ballesteros (Universidad de Valencia), Bartolo Luque (Universidad Politécnica de Madrid) y Jordi Bascompte (Universidad de Zúrich), utilizó un enfoque interdisciplinario que combina la física de sistemas complejos, la biología computacional y la estadística para demostrar que este límite fue el detonante de la mayor revolución en la historia biológica.

Cuantificación de la transición de fase

La investigación se basa en el análisis de 6519 especies iniciales, una cifra que se expandió a más de 33.627 genomas y 9913 proteomas en las fases finales del estudio para verificar la universalidad de los patrones observados. Los autores descubrieron que la distribución del tamaño de los genes y las proteínas sigue una distribución log-normal en todo el árbol de la vida.

Estas distribuciones son características de procesos estocásticos multiplicativos, lo que implica que el crecimiento de los genes no ocurre por adición simple de nucleótidos, sino a través de operadores genéticos que multiplican la longitud de las secuencias.

El punto crítico de esta evolución se sitúa en una longitud genética media de 1500 nucleótidos. En este umbral, los datos muestran que las proteínas se «desacoplaron» del crecimiento del gen. Mientras que en los procariontes el tamaño de la proteína sigue creciendo a medida que lo hace el gen, en los eucariotas el tamaño medio de la proteína se estabiliza en torno a los 500 aminoácidos, independientemente de que el gen siga creciendo en longitud.

| Característica | Fase Procarionte (Coding Phase) | Fase Eucariote (Non-Coding Phase) |

| Arquitectura Genética | Genes continuos y compactos | Genes interrumpidos (Exones e Intrones) |

| Relación Gen/Proteína | Proporcionalidad lineal directa | Desacoplamiento estructural |

| Umbral Crítico (Gen) | < 1.500 nucleótidos | > 1.500 nucleótidos |

| Tamaño Proteico Medio | Variable según longitud del gen | Estabilizado en ~500 aminoácidos |

| Regulación | Basada en longitud de proteínas | Basada en secuencias no codificantes |

Tabla 1: Diferencias fundamentales en la organización genómica antes y después de la transición de fase algorítmica.

El mecanismo: Del hardware proteico al software regulatorio

El cambio de «sistema operativo» descrito por los científicos españoles implica una transición desde un sistema donde la complejidad se gestionaba mediante el hardware (el tamaño físico de las proteínas) hacia uno donde la complejidad reside en el software (la gestión de la información no codificante). Esta innovación se materializó a través de la incorporación de secuencias no codificantes, principalmente intrones, en el interior de los genes.

La presencia de intrones permitió a la evolución utilizar el mecanismo de corte y empalme (splicing). En lugar de tener que «buscar» una sola proteína gigantesca y funcional en un espacio de posibilidades infinito, el sistema eucariota podía combinar diferentes fragmentos de proteínas (exones) para generar múltiples variantes a partir de un solo gen. Este enfoque modular redujo drásticamente la complejidad computacional de la búsqueda evolutiva, transformando un problema intratable en uno manejable mediante permutaciones.

Sin embargo, esta actualización del software requería una infraestructura física nueva: el núcleo celular y el espliceosoma. En las bacterias, la transcripción y la traducción ocurren de forma simultánea. Esto impide cualquier edición del mensaje genético antes de que se convierta en proteína. El núcleo celular actuó como una barrera física que separó estos dos procesos en el tiempo y el espacio, permitiendo que la célula «editara» el ARN (eliminando los intrones) antes de enviarlo a la maquinaria de síntesis de proteínas. El espliceosoma, por su parte, se convirtió en el procesador central encargado de ejecutar este complejo algoritmo de edición.

El fin de los «genes continuos»

En los organismos simples (procariontes), los genes son como instrucciones seguidas: cada letra del gen se traduce directamente en una parte de la proteína.Sin embargo, esto tiene un límite físico: si el gen es muy largo, la proteína resultante es tan grande que es estadísticamente imposible que se pliegue correctamente o sea funcional.

Los Intrones: El «espacio en blanco» inteligente

La innovación consistió en insertar intrones (secuencias de ADN que no codifican proteínas) en medio de los genes.

- Antes: El gen era una sola pieza rígida.

- Después: El gen se convirtió en un conjunto de piezas útiles (exones) separadas por «espacio» (intrones).

Del «Bloque» al «LEGO» (Splicing)

Al tener el gen dividido en fragmentos, la célula pudo implementar el mecanismo de splicing (corte y empalme).Esto permite:

- Modularidad: En lugar de buscar una proteína gigante perfecta, la célula combina pequeños fragmentos (exones) de diferentes maneras.

- Eficiencia: Un solo gen puede producir muchas variantes de proteínas distintas, reduciendo drásticamente el «coste» computacional de la evolución.

La necesidad de un «despacho» (El Núcleo)

Esta edición de mensajes genéticos no podía ocurrir en cualquier lugar.En las bacterias, la fabricación de proteínas es inmediata y caótica.Para que esta «innovación de software» funcionara, la célula eucariota desarrolló el núcleo.

- El núcleo actúa como una barrera física que separa la lectura del ADN de la fabricación de la proteína.

- Esto le da tiempo a la célula para «editar» el mensaje (eliminar los intrones) antes de enviarlo a la maquinaria de síntesis.

En resumen, los intrones no son «basura genética»; son los espacios que permiten que el código de la vida sea flexible y combinatorio, permitiendo que existan organismos tan complejos como los seres humanos.

Leyes de escala y modelado matemático

Uno de los aportes más robustos del estudio es la formulación de una ley de escala universal que gobierna el crecimiento de los genes. El modelo postula que existe una relación invariante de escala entre la media de la longitud de los genes y su varianza.

Esta relación se expresa matemáticamente mediante una ley alométrica:

Var(L) = α⟨L⟩^β

Donde L representa la longitud del gen. Esta ley se mantiene constante a lo largo de tres órdenes de magnitud de variación, desde las bacterias más simples hasta los vertebrados más complejos. El hecho de que esta relación sea universal sugiere que los mecanismos moleculares de duplicación de genes, barajado de exones y ganancia de intrones actúan bajo restricciones físicas profundas que no han cambiado en miles de millones de años.

El modelo demuestra que, durante la fase procarionte, la longitud de la proteína seguía el crecimiento del gen para satisfacer las necesidades regulatorias. Pero al llegar al punto crítico, la tensión entre la necesidad de genes más largos (más información) y la imposibilidad de fabricar proteínas más largas (límites de plegamiento y energía) se resolvió de forma abrupta pero continua mediante la transición hacia la regulación por ADN no codificante.

Implicaciones filosóficas y el debate sobre el azar

Este estudio reabre un debate fundamental en la biología evolutiva: ¿es la vida un producto del azar o de la necesidad física? El biólogo Stephen Jay Gould propuso en su famoso experimento mental que, si rebobináramos la cinta de la vida y la dejáramos correr de nuevo, los humanos probablemente no existiríamos, ya que la evolución es un proceso de contingencias aleatorias.

Sin embargo, los hallazgos de Muro, Ballesteros, Luque y Bascompte sugieren una visión más determinista. Según su modelo, una vez que la vida alcanzó la primera célula autorregulada, las leyes de la física y la computación determinaron que, inevitablemente, tendría que producirse un salto hacia un nuevo sistema de organización un mil millones de años después. Como afirma Bartolo Luque, «la física del problema determinó que algo verdaderamente nuevo aparecería… no sabíamos qué sería exactamente, pero sí que sería una transición algorítmica».

Esta perspectiva desplaza el foco desde el «cómo» ocurrió el salto (la endosimbiosis) hacia el «por qué» fue necesario en ese momento preciso de la historia de la Tierra. El surgimiento de los eucariotas deja de verse como un golpe de suerte extraordinario para interpretarse como una solución obligada ante un agotamiento del modelo procarionte.

Página 1/3